دادگان PCoQA: Persian Conversational Question Answering

دادگان (دیتاست) جدیدی به نام PCoQA منتشر شده که شامل ۹۰۲۶ پرسش از ۸۷۰ صفحه ویکیپدیاست. هر گفتمان (conversation) روی یک صفحه ویکیپدیا انجام شده و طول هر گفتمان هم حدودا ۱۰ است. به منظور ارزیابی انسانی شبیه دادگانهای گذشته مثل SQuAD و CoQA، برای هر پرسش در مجموعهی ارزیابی و تست چندین پاسخ دراومده و دقت F1 انسانها و چندین مدل بر روی پاسخدهی به این پرسشها بدست اومده که برای انسان حدودا ۸۶ درصده.

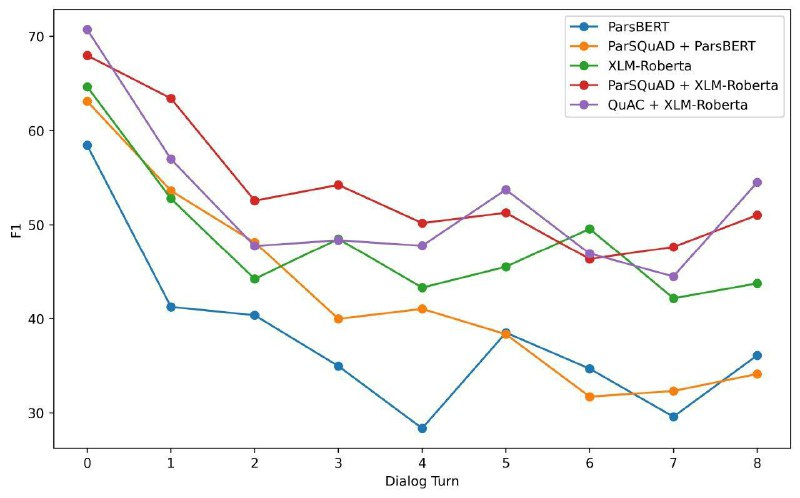

دو نوع مدل روی این داده تست شده. یکی با فقط فاینتیون کردن چند مدل زبانی ترنسفورمری روی همین دادگان و یک مدل دیگه هم با فاینتیون کردن مدل روی دادگان قبلی QA و بعد فاین تیون روی این دادگان و بعد تست گرفتن.

دو خصوصیت مهم این دیتاست:

- پرسشهای این دادگان بیشتر open ended هستند، بر خلاف قبلیها مثل CoQA و SQuAD که بیشتر به شکلی مصنوعی بر روی named entity و noun phrase متمرکزند.

- سعی شده lexical overlap تا حد امکان کاهش داده بشه تا کیفیت بالاتر بیاد.

لینک مقاله:

arxiv.org/abs/2312.04362

لینک گیتهاب:

github.com/HamedHematian/PCoQA

#dataset

@nlp_stuff

دادگان (دیتاست) جدیدی به نام PCoQA منتشر شده که شامل ۹۰۲۶ پرسش از ۸۷۰ صفحه ویکیپدیاست. هر گفتمان (conversation) روی یک صفحه ویکیپدیا انجام شده و طول هر گفتمان هم حدودا ۱۰ است. به منظور ارزیابی انسانی شبیه دادگانهای گذشته مثل SQuAD و CoQA، برای هر پرسش در مجموعهی ارزیابی و تست چندین پاسخ دراومده و دقت F1 انسانها و چندین مدل بر روی پاسخدهی به این پرسشها بدست اومده که برای انسان حدودا ۸۶ درصده.

دو نوع مدل روی این داده تست شده. یکی با فقط فاینتیون کردن چند مدل زبانی ترنسفورمری روی همین دادگان و یک مدل دیگه هم با فاینتیون کردن مدل روی دادگان قبلی QA و بعد فاین تیون روی این دادگان و بعد تست گرفتن.

دو خصوصیت مهم این دیتاست:

- پرسشهای این دادگان بیشتر open ended هستند، بر خلاف قبلیها مثل CoQA و SQuAD که بیشتر به شکلی مصنوعی بر روی named entity و noun phrase متمرکزند.

- سعی شده lexical overlap تا حد امکان کاهش داده بشه تا کیفیت بالاتر بیاد.

لینک مقاله:

arxiv.org/abs/2312.04362

لینک گیتهاب:

github.com/HamedHematian/PCoQA

#dataset

@nlp_stuff

tg-me.com/nlp_stuff/345

Create:

Last Update:

Last Update:

دادگان PCoQA: Persian Conversational Question Answering

دادگان (دیتاست) جدیدی به نام PCoQA منتشر شده که شامل ۹۰۲۶ پرسش از ۸۷۰ صفحه ویکیپدیاست. هر گفتمان (conversation) روی یک صفحه ویکیپدیا انجام شده و طول هر گفتمان هم حدودا ۱۰ است. به منظور ارزیابی انسانی شبیه دادگانهای گذشته مثل SQuAD و CoQA، برای هر پرسش در مجموعهی ارزیابی و تست چندین پاسخ دراومده و دقت F1 انسانها و چندین مدل بر روی پاسخدهی به این پرسشها بدست اومده که برای انسان حدودا ۸۶ درصده.

دو نوع مدل روی این داده تست شده. یکی با فقط فاینتیون کردن چند مدل زبانی ترنسفورمری روی همین دادگان و یک مدل دیگه هم با فاینتیون کردن مدل روی دادگان قبلی QA و بعد فاین تیون روی این دادگان و بعد تست گرفتن.

دو خصوصیت مهم این دیتاست:

- پرسشهای این دادگان بیشتر open ended هستند، بر خلاف قبلیها مثل CoQA و SQuAD که بیشتر به شکلی مصنوعی بر روی named entity و noun phrase متمرکزند.

- سعی شده lexical overlap تا حد امکان کاهش داده بشه تا کیفیت بالاتر بیاد.

لینک مقاله:

arxiv.org/abs/2312.04362

لینک گیتهاب:

github.com/HamedHematian/PCoQA

#dataset

@nlp_stuff

دادگان (دیتاست) جدیدی به نام PCoQA منتشر شده که شامل ۹۰۲۶ پرسش از ۸۷۰ صفحه ویکیپدیاست. هر گفتمان (conversation) روی یک صفحه ویکیپدیا انجام شده و طول هر گفتمان هم حدودا ۱۰ است. به منظور ارزیابی انسانی شبیه دادگانهای گذشته مثل SQuAD و CoQA، برای هر پرسش در مجموعهی ارزیابی و تست چندین پاسخ دراومده و دقت F1 انسانها و چندین مدل بر روی پاسخدهی به این پرسشها بدست اومده که برای انسان حدودا ۸۶ درصده.

دو نوع مدل روی این داده تست شده. یکی با فقط فاینتیون کردن چند مدل زبانی ترنسفورمری روی همین دادگان و یک مدل دیگه هم با فاینتیون کردن مدل روی دادگان قبلی QA و بعد فاین تیون روی این دادگان و بعد تست گرفتن.

دو خصوصیت مهم این دیتاست:

- پرسشهای این دادگان بیشتر open ended هستند، بر خلاف قبلیها مثل CoQA و SQuAD که بیشتر به شکلی مصنوعی بر روی named entity و noun phrase متمرکزند.

- سعی شده lexical overlap تا حد امکان کاهش داده بشه تا کیفیت بالاتر بیاد.

لینک مقاله:

arxiv.org/abs/2312.04362

لینک گیتهاب:

github.com/HamedHematian/PCoQA

#dataset

@nlp_stuff

BY NLP stuff

Share with your friend now:

tg-me.com/nlp_stuff/345