tg-me.com/ds_interview_lib/838

Last Update:

Как работает градиентный бустинг, и в чем его преимущества перед классическим бустингом

Ответ:

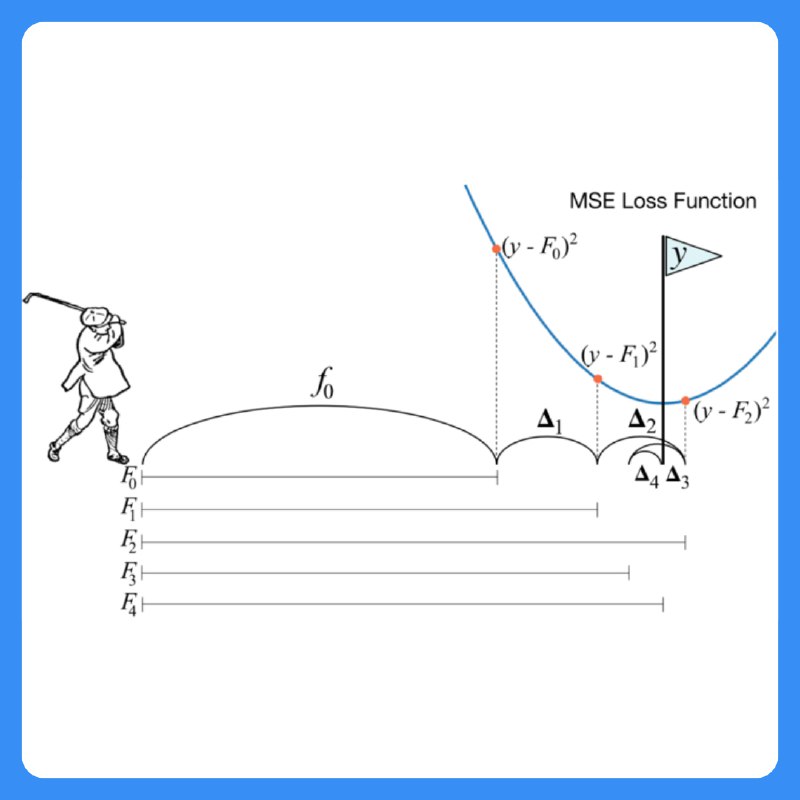

Градиентный бустинг (Gradient Boosting) — это ансамблевый метод, в котором слабые модели (обычно деревья решений) обучаются последовательно, и каждая следующая модель корректирует ошибки предыдущей. В отличие от классического бустинга (AdaBoost), градиентный бустинг минимизирует функцию потерь с помощью градиентного спуска.

Как работает:

▪️ Первая модель обучается на исходных данных.

▪️ Далее вычисляется остаточная ошибка (разница между предсказанными и реальными значениями).

▪️ Следующая модель обучается на этой ошибке, пытаясь её минимизировать.

▪️ Процесс повторяется, и все модели комбинируются для финального предсказания.

BY Библиотека собеса по Data Science | вопросы с собеседований

Share with your friend now:

tg-me.com/ds_interview_lib/838